◎王宏恩/內華達大學拉斯維加斯分校政治系副教授

自從2022年ChatGPT正式上線以來,人類的生活已經產生極大的改變。現在AI工具已經是工程師撰寫程式碼以及學生撰寫報告的必備工具,相關的AI應用也越來越頻繁出現在各個領域之中。過去許多AI生成的影片與文字,都有明顯的機器人痕跡(還記得AI製圖的六根手指以及不會吃麵嗎? https://en.wikipedia.org/wiki/Will_Smith_Eating_Spaghetti_test ),但這些問題隨著AI模型不斷進化,都已經慢慢消失了,現在我們已經愈來愈難區分AI製圖與真實的照片。

一群跨國的政治學、心理學、管理學研究團隊就決定研究這個政治科學領域裡面最重要的問題:AI是否可能成功地說服選民改變政治立場?這個重要的問題,讓這個研究團隊的兩篇文章同時刊登在頂尖期刊Nature以及Science:

Lin, H., Czarnek, G., Lewis, B., White, J. P., Berinsky, A. J., Costello, T., … & Rand, D. G. (2025). Persuading voters using human–artificial intelligence dialogues. Nature, 1-8.

https://www.nature.com/articles/s41586-025-09771-9

Hackenburg, K., Tappin, B. M., Hewitt, L., Saunders, E., Black, S., Lin, H., … & Summerfield, C. (2025). The levers of political persuasion with conversational artificial intelligence. Science, 390(6777), eaea3884.

過去的政治科學研究大多顯示,人們要改變立場並不容易。人們對於政策偏好會改變立場,往往是因為(1)他支持的政治人物也對該議題改變立場1 (2) 他周遭有過半的人持有反面立場 2 (3) 他有一些特別重視、不容妥協的議題立場正好跟他支持的政黨不同 3 (4) 經過長時間的審議 4。

然而, ChatGPT等AI工具因為可以快速、大量的製造針對個人化的特定訊息、而且可以即時回饋給使用者,加上不是真人而沒有社交壓力,所以假如這樣的AI工具可以有效地大規模說服民眾支持或反對特定政策,對於未來民主發展會有可觀的影響。

同時,要去驗證這樣的平台傳遞的資訊是否影響民意並不容易,因為許多使用者可能上去只想聽自己想聽的話、或是誘導AI平台只支持自己的觀點等。換言之,假如要建立因果關係『原有態度–>AI平台提供資訊–>改變態度』,從實驗法的角度來看,必須要

(1)測量民眾原有的政治態度

(2)給予不同民眾不同的刺激,一些給予跟民眾既有態度同方向的AI生成說帖,一些給AI生成反方向的說帖

(3) 再次測量民眾的態度,是否會隨著說帖方向改變

而這也是這研究團隊第一篇在Nature的文章的主要研究方法。他們分別在三個實驗中,用AI說服民眾改變對於政治人物以及議題的看法,包括(1) 2300位美國總統大選選民、(2) 501位麻州公投迷幻蘑菇合法化選民、以及(3) 1500加拿大跟2000波蘭大選選民。

在三個實驗中,受訪者都先填寫前測問卷,表達對候選人以及議題的看法。它們接著被要求與訓練過的AI互動(平均6分鐘),而AI被隨機指示要拿到受訪者的前測態度後客製化生成說服選民的內容,而內容則是被隨機分派要支持特定方向、以及含有多少事實層面的說詞(與之對應的是強調個人特質或心理技巧策略)。互動之後,受訪者再填後測問卷重新評估對候選人或議題的看法。(AI模型分別為作者設計、GPT4.1、DeepSeekV3、Llama4Mav等)。

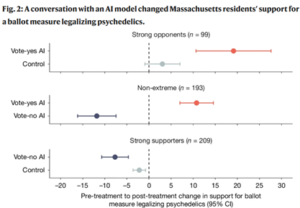

結果發現,在三個實驗中,受訪者在跟AI互動之後,態度都更顯著地往AI支持的方向移動。例如在下圖中(原文圖二),第一欄代表原本極度反對迷幻蘑菇合法化的選民,當跟支持該法案的AI互動後(vote-yes AI),顯著地開始支持法案合法化(往虛線右邊移動)。相較之下,最下面第三欄代表本來極度支持合法化的選民,當跟反對該法案的AI互動後(vote-no AI),顯著地開始反對法案合法化(往虛線左邊移動)。簡單來說,AI的確具有說服選民改變政治態度的效果!

然而,大家一定也有想到,AI說服的效果可能因人而異。而在前面的實驗中,AI跟每個受試者互動了六分鐘,到底裡面講了什麼,也許才是關鍵。可能某些類型的說詞對於選民特別有效、另一些說服策略則可能毫無效果。

因此,在另一篇發上Science的文章,這個研究團隊共邀請了將近80000位英國的受訪者,測試19種不同的LLM模型(包括通義千問、Llama、ChatGPT、Grok)在700個政治議題上的說服效果,一共測試了將近46萬次。每次都要受訪者跟AI對話2到10次,並且同樣紀錄受訪者的態度改變。最後,研究人員平均跟不同AI模型互動的受訪者的態度平均的改變程度,就可以用來測量並比較不同AI模型的『說服人』的程度高低。

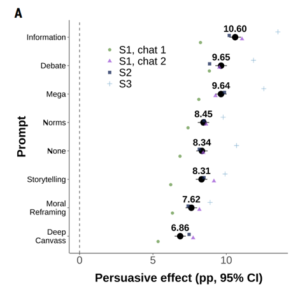

除此之外,這個研究團隊也有針對AI進行實驗設計,有許多受試者不是單純被分配到一個AI模型對話,而是研究人員有先跟這個AI說要怎麼對話,例如『用說故事的方式』、『多提供事實』、『多道德勸說』等,用來觀察哪一種說法會更有效。

結果如下圖(原圖3A)。平均而言,當AI使用『多提供事實』這個策略,包括多提供數字、新聞連結等,其說服效果是最大的。相較之下,使用道德勸說的方式,結果反而比沒有特別訓練給予指示的AI(None)還要更差。

另外,研究人員也發現,至少在研究人員測試的19種模型中,越大的模型(參數越多、計算越多)平均而言說服效果還是比較好。

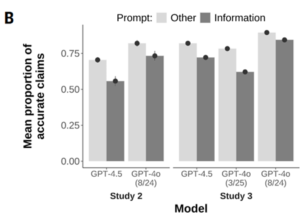

從結果看來,讓AI多用事實跟數字來說服人看起來最有效果,但研究人員也馬上發現一個大問題:當研究人員特別叫AI要『多提供事實』來說服受試者時,AI為了要說服,反而可能會『特別編造事實』!研究人員整理了AI跟受試者的對話紀錄,並額外使用事實查核機構提供的資料來驗證AI講的每句話的真假。結果發現(如下圖,原文圖4B),當AI模型特別被先要求要多提供事實時,雖然在說服內容的篇幅上的確會給更多數字跟新聞,但是裡面真實性也大幅下降,代表AI會偷偷編造數字或假資訊來源來說服受試者,只為了讓讀者會改變政治立場,達到AI被告知的工作目標。

這兩篇文章都是使用超級大規模的實驗法,而且做得非常及時(用2025年5月底出爐的最新AI模型),也橫跨不同的政治議題與領域,並且也有巧思(設計不同的說服方法等),因此被學術界最頂尖的期刊Nature以及Science接受。讀者看到這裡,也可以知道這是兩篇非常重要的文章。

這裡值得注意的是,這篇文章的實驗強度是很強的,因為受試者被要求跟AI互動六分鐘,這時間內受試者是全神貫注的接收AI的資訊,而且受試者事前就知道要跟AI互動,這些可能誇大了AI的說服效果。但反過來說,假如各位讀者日常在網路上跟不知名網友唇槍舌戰,但假如這名網友背後其實是AI,是否各位讀者可能就在不知情的情況下被這個套皮AI給說服改變立場了呢?

如同本文一開始所說,AI的優勢就是可以大規模的個人化與工作自動化,假如今天有政治人物或政黨或其他國家的勢力,控制兩千三百萬個AI說客,每個模型都特別先收集你的社群網站資料以及過往發言、然後針對每個人都專門制定一個個人化說帖、開始隨時在網路上追蹤你、跟你互動來說服你改變立場,這樣對於整個民主制度的發展是否是一種危機呢?這些都是接下來人類跟民主制度需要去重視並探討的問題。

- Michael Barber and Jeremy Pope, 2019. https://www.cambridge.org/core/journals/american-political-science-review/article/abs/does-party-trump-ideology-disentangling-party-and-ideology-in-america/B5BAD0AE947BD3CF18D51D399263C8D3. ↩

- Huckfeldt, R., Johnson, P. E., & Sprague, J. (2004). Political disagreement: The survival of diverse opinions within communication networks. Cambridge University Press. ↩

- Hillygus, D. S., & Shields, T. G. (2014). The persuadable voter: Wedge issues in presidential campaigns. ↩

- Gastil, J., Black, L., & Moscovitz, K. (2008). Ideology, attitude change, and deliberation in small face-to-face groups. Political Communication, 25(1), 23-46. ↩